Esto ya lo hemos vivido y no termina bien porque acaba ganando el Estado

Sin comentariosFacebookTwitterFlipboardE-mail 2026-02-27T13:30:56ZJavier Pastor

Editor Senior - TechJavier Pastor

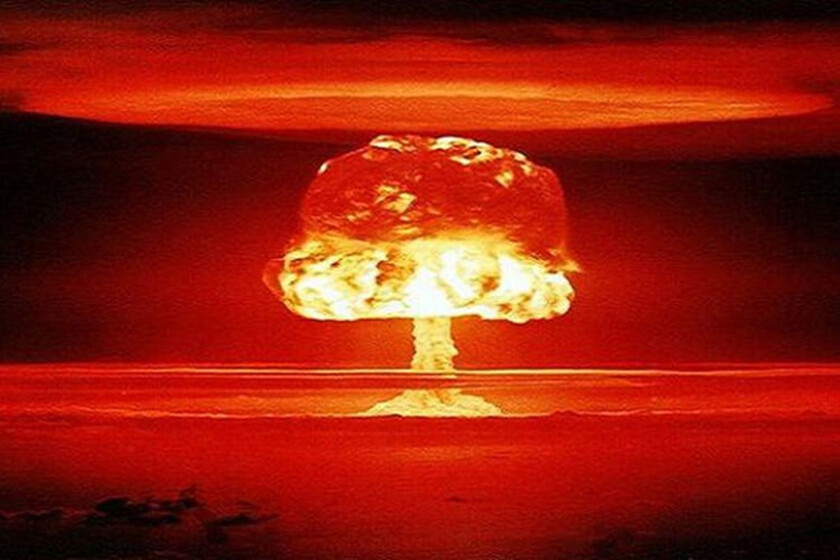

Editor Senior - Tech Linkedintwitter9881 publicaciones de Javier PastorAnthropic se ha negado a ceder a las presiones del Pentágono. Su cofundador y CEO, Dario Amodei, acaba de publicar un comunicado en el que deja claro que no están dispuestos a romper sus principios éticos. Nada de espionaje masivo con IA, nada de desarrollo de armas autónomas letales con sus modelos. Y eso nos recuerda un caso terrible: el de la bomba atómica.

De héroe a villano. J. Robert Oppenheimer pasó de ser el "padre de la bomba atómica" y un héroe nacional a convertirse en un paria. Su pecado no fue la traición, sino su claridad moral. Tras presenciar el horror de Hiroshima y Nagasaki, Oppenheimer trató desesperadamente de frenar la escalada atómica y el desarrollo de la bomba de hidrógeno.

O estás con nosotros, o contra nosotros. EEUU, que le había ensalzado en el pasado, aprovechó sus antiguas afiliaciones políticas y le despojó de todos sus privilegios e influencia. Aquello demostró cómo el gobierno estadounidense decidió sin más que el conocimiento científico era propiedad del estado y que cualquier investigador que intentara proponer límites éticos a sus propios proyectos sería tratado como un enemigo de la patria.

La historia está amenazando con repetirse estos días.

En XatakaAnthropic y OpenAI han desarrollado la IA. El Pentágono de EEUU les está mostrando quién es su dueño realmenteDe Oppenheimer a Anthropic. Lo está haciendo con un protagonista que sigue ahí —el Gobierno de EEUU— y otro que cambia: quien defiende ahora la ética de un proyecto científico-tecnológico no es Oppenheimer, sino Dario Amodei, CEO de Anthropic.

Claude es cada vez más vital en el Gobierno de EEUU. Su empresa está estos días entre la espada y la pared. Anthropic logró que su modelo Claude se convirtiera en la niña bonita del Gobierno de EEUU. La capacidad de esta IA ha demostrado ser tan notable que al parecer fue utilizado para planificar el arresto del expresidente de Venezuela, Nicolás Maduro.

Líneas rojas. Pero para que el Pentágono pudiese utilizar Claude, Anthropic impuso ciertas líneas rojas. Nada de usarlo para vigilancia masiva de ciudadanos de EEUU, y nada de usarlo para desarrollo de armas letales autónomas. Y al Pentágono han acabado por no gustarle esas líneas rojas, así que quiere eliminarlas y usar Claude como le venga en gana siempre y cuando, dicen, se respete la Constitución y las leyes estadounidenses.

El Pentágono quiere una IA sin cortapisas. Eso ha acabado provocando una situación enormemente tensa estos días. El Pentágono amenazó con castigar a Anthropic si no cedía a sus pretensiones, y esas amenazas del Departamento de Defensa no han sido sutiles en absoluto. De hecho, han sugerido que podrían calificar a Anthropic como una empresa que es "un riesgo para la cadena de suministro", una etiqueta negra que normalmente se reserva para empresas de países rivales como China o Rusia.

Contradicción. El propio Dario Amodei explicaba en una entrada en el blog oficial de la empresa que esas dos amenazas eran autoexcluyentes: "Estas dos últimas amenazas son inherentemente contradictorias: una nos etiqueta como un riesgo para la seguridad; la otra etiqueta a Claude como esencial para la seguridad nacional".

¿Se puede nacionalizar la IA? Es una ironía inquietante: el mismo gobierno que considera que Claude es una herramienta esencial para la seguridad nacional está dispuesto a calificar a sus creadores como una amenaza pública si no entregan las llaves del reino y de su IA. Lo que quieren el Departamento de Defensa y el Pentágono es básicamente "nacionalizar" la tecnología de IA desarrollada por Anthropic y apropiarse de ella como ya hicieron con la tecnología que dio lugar a la bomba atómica. Sabemos cómo acabó aquello.

Anthropic se niega a ceder. El peligro es enorme en ambos apartados: la vigilancia masiva, más que defender la democracia puede dinamitarla desde dentro, y el escándalo de la NSA es un buen ejemplo. Pero más preocupante incluso es la intención del Pentágono de usar esta IA para desarrollar armas letales autónomas. Amodei insistía en este punto indicando que "Los modelos fundacionales de IA simplemente no son lo suficientemente fiables como para impulsar armas totalmente autónomas. No proporcionaremos, a sabiendas, un producto que ponga en riesgo a los combatientes y civiles estadounidenses".

Amodei incluso ofrece al Departamento de Guerra/Defensa ayudar en la "transición a otro proveedor" de modelos de IA, pero de momento no está claro qué camino tomará el gobierno estadounidense.

Momento Oppenheimer. Si el Pentágono finalmente ejecuta su amenaza y veta a Anthropic, el mensaje para la industria será escalofriante. En la era de la IA no hay objetores de conciencia: si una empresa desarrolla una ventaja tecnológica y estratégica a nivel militar, esa empresa queda a merced del Estado. Es un nuevo y terrorífico "Momento Oppenheimer" que condiciona el futuro no ya de Anthropic, sino del propio desarrollo de modelos de IA.