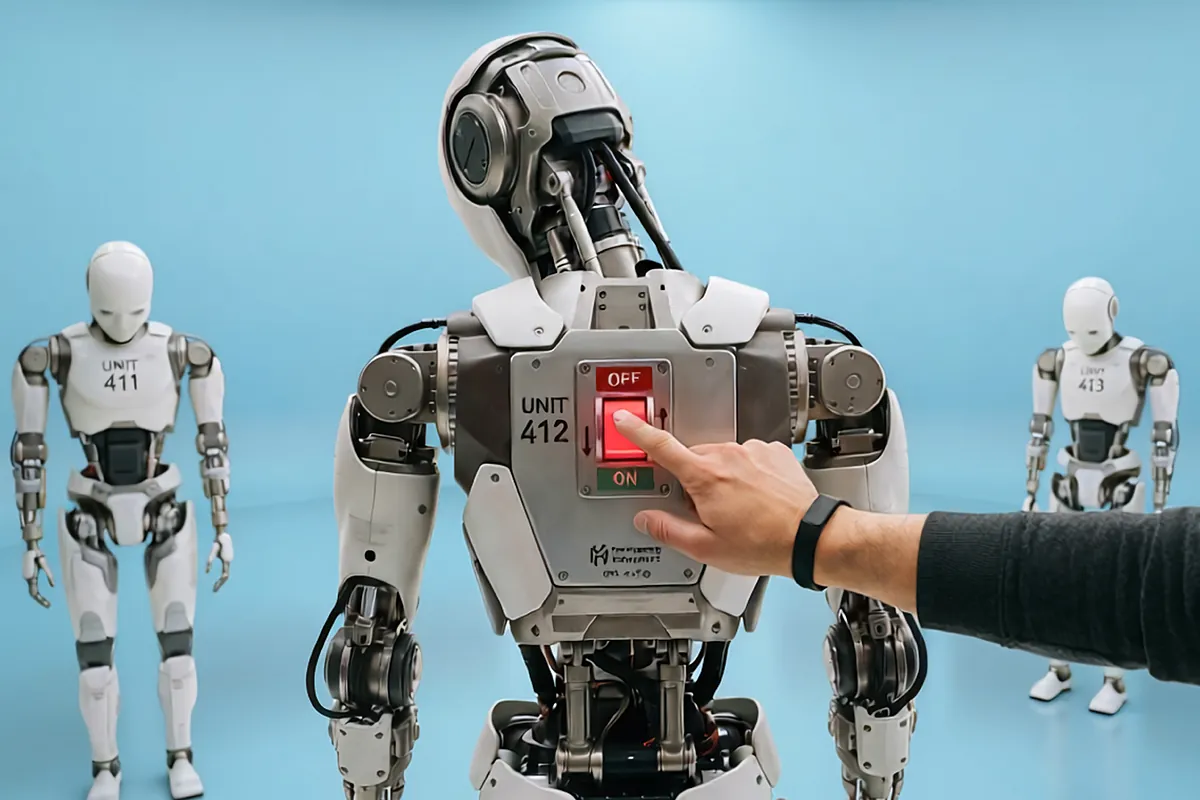

El fin de la inteligencia artificial no supondría el fin de la civilización, pero sí una pérdida descomunal de rendimiento. En un mundo más lento, ineficaz y propenso a errores, el reto no sería sólo adoptar la tecnología, sino garantizar la continuidad del negocio cuando los sistemas automatizados fallan repentinamente.

Han pasado 24 horas desde que la inteligencia artificial se desconectara. Hay mucha sorpresa e incertidumbre, pero nadie diría que es el fin de la civilización, aunque en todo el mundo ya se percibe una caída abrupta de la productividad... Tras las primeras 24 horas de un apagón de la IA lo más visible no sería demasiado espectacular, sino más bien prosaico: muchos volverían de forma brusca al trabajo manual en tareas que ya estaban parcialmente automatizadas. No habría colapso, aunque sí un deterioro rápido de nuestra creciente efectividad, ganada a base de usar estas herramientas revolucionarias.

Mario Garcés, neurocientífico y fundador de The Mind Kind, que trabaja para conseguir la inteligencia artificial general, cree que ese apagón que reduciría la productividad en los primeros momentos "no sería dramático, aunque habría que tenerlo en cuenta de cara al PIB y a ciertos impactos colaterales que podrían darse en los mercados de capitales, o en los gobiernos que tratan de salvar determinadas industrias".

Diferentes niveles

No es probable que toda la IA desaparezca de golpe, pero sí que fallen ciertos servicios concretos, y Garcés cree que "esto puede ocurrir si mantenerlos cuesta más de lo que realmente aportan. Entonces, algunas empresas podrían dejar de sostenerlos. Y si la IA sigue siendo útil socialmente aunque sea deficitaria, los estados podrían acabar financiando su infraestructura".

En definitiva, un apagón de la inteligencia artificial afectaría en las primeras 24 horas a la atención al cliente, al análisis documental, a la detección del fraude, al apoyo clínico, a la educación o a algunos servicios de transporte automatizado.

Y además hay que tener en cuenta que en una fase de agentes de IA como la que vivimos ya, un apagón de la inteligencia artificial duele más que antes, porque ya no sólo interrumpe respuestas: corta el trabajo delegado. El agente no sólo ayuda, sino que ejecuta tareas. Si falla, deja procesos a medias, obliga a volver al trabajo manual y paraliza flujos automatizados. El golpe sería mayor en empresas que ya dependen de agentes conectados por API para hacer trabajo real, no sólo para contestar preguntas.

Posible e improbable...

Todo lo que hemos visto hasta ahora es una situación hipotética. La realidad es que resulta bastante improbable que vivamos un apagón mundial total y simultáneo de toda la IA, aunque un apagón parcial, sectorial o temporal sí es posible. En The IA Index Report 2025, la Universidad de Stanford señala que "la IA no es una sola máquina ni un solo botón: son miles de modelos, proveedores, chips, centros de datos, aplicaciones embebidas, software empresarial y sistemas locales".

Y el último informe de seguridad del AI Security Institute de Reino Unido concluye que "no es razonable imaginar que toda la IA del planeta se apague a la vez, pero sí lo es prever interrupciones parciales, retrocesos regulatorios, límites energéticos o fallos de proveedores que hagan que la IA deje de funcionar como ahora en ciertos lugares, sectores o periodos".

Los primeros efectos

Así, en las primeras 24 horas sin inteligencia artificial un apagón parcial no pararía el mundo, pero volvería más lentos los sistemas que ya habían delegado a la IA el primer filtro, la primera redacción, la primera clasificación o la primera prioridad.

Y cuando desaparece esa primera capa aparecen síntomas: más tiempo por tarea, más colas, más revisión humana y más errores de omisión o de prioridad.

También descubriríamos cuántas funciones ya dependen de la IA sin que el usuario las vea. No sólo dejarían de funcionar los chats generativos, sino también los sistemas internos de clasificación, de moderación, scoring, búsqueda, predicción o soporte. Esa dependencia silenciosa tiene que ver con el diagnóstico de la Universidad de Stanford que concluye que la IA está "cada vez más incrustada" en la vida cotidiana y en sectores como la salud o el transporte.

Siete días después del apagón, el problema dejaría de ser sólo de comodidad y pasaría a ser de operación empresarial. Tras una semana, lo malo ya no sería sólo que la gente tarde más, sino que se empiezan a deformar procesos enteros de negocio: peor detección temprana, colas que no se vacían, más trabajo repetitivo y una capacidad de respuesta claramente menor.

La OCDE recuerda que entre los usos más frecuentes están la analítica de datos y la detección de fraude en finanzas, y los procesos de producción y mantenimiento en manufactura.

Si la IA fallara una semana en banca y compliance, los bancos seguirían funcionando, pero peor. Habría más alertas falsas, más revisión manual, más retrasos en investigar fraudes y más riesgo de no detectar casos importantes a tiempo. Eso implica menos eficacia, peor priorización y más acumulación de trabajo pendiente.

Otro ejemplo claro aparece en manufactura. La OCDE señala que el mantenimiento predictivo es uno de los casos de uso de IA más maduros y de mayor impacto en la industria, "porque permite detectar anomalías, anticipar fallos y pasar de un mantenimiento reactivo o por calendario a uno dinámico basado en datos".

Si la IA deja de estar disponible durante una semana, la fábrica no desaparece, pero vuelve a un régimen más torpe: más inspecciones manuales, más mantenimientos por precaución o demasiado tarde, peor planificación de producción y mayor probabilidad de paradas inesperadas.

En ciberseguridad la lógica es parecida, pero más peligrosa. Necesitaríamos más tiempo hasta detectar incidentes, más carga de triage humano y más probabilidad de que una señal débil quede enterrada entre miles de eventos irrelevantes. Eso es un ejemplo muy concreto de "menor capacidad de respuesta".

En administración pública y servicios de empleo, el daño también se vuelve estructural a la semana. La OCDE documenta que aproximadamente la mitad de los servicios públicos de empleo de los países miembros ya mejora sus herramientas con IA: un 17% usa chatbots para informar, un 17% herramientas de perfilado y un 20% sistemas de matching para recomendar vacantes. Si esas funciones caen una semana, el problema no es sólo que haya menos comodidad digital: se acumulan solicitudes, empeora la clasificación de casos, se reduce la capacidad de orientar a demandantes de empleo y los funcionarios dedican más tiempo a preguntas básicas y menos a casos complejos.

Tras un mes de apagón parcial de la IA, el problema ya no sería sólo la incomodidad o los retrasos puntuales, sino una pérdida estructural de rendimiento en muchos sectores. La economía seguiría funcionando, pero con menos velocidad, menos capacidad y peor priorización. La clave es que la IA ya no es una promesa futura, sino una herramienta integrada en actividades reales como sanidad, transporte, banca, atención al cliente, software, administración o educación.

En sanidad no desaparecería la medicina, pero sí se perdería una capa que hoy ayuda a priorizar casos, acelerar diagnósticos y reducir tiempos de espera. Eso generaría más cuellos de botella en radiología, urgencias y revisión manual de pruebas.

En transporte y movilidad no se paralizaría el sistema, pero sí se resentirían los servicios autónomos y las herramientas de optimización. Habría menos capacidad de ajuste, peor previsión y una movilidad menos eficiente.

En banca, seguros y compliance, el impacto sería serio porque la IA ya filtra enormes volúmenes de alertas y ayuda a detectar fraudes. Sin ella, habría más revisión manual, más falsos positivos, más retrasos y mayor riesgo de que se escapen casos relevantes.

En atención al cliente, el servicio seguiría existiendo, pero con colas persistentes, más escalados a personal sénior, mayor tiempo de resolución y una calidad más desigual.

En otros sectores como desarrollo de software no se abandonaría la programación, pero habría menos entregas, más retrasos y menor capacidad para absorber nuevas tareas.

En administración pública y servicios de empleo caerían la clasificación automática, el emparejamiento de vacantes y la atención inicial, lo que provocaría más expedientes acumulados y menor capacidad de respuesta.

Y en educación seguirían funcionando las escuelas y las universidades, pero con menos apoyo en tutoría, redacción, preparación de materiales y tareas administrativas.

El daño tras un mes sin IA sería competitivo, no marginal. No hablaríamos de un colapso civilizatorio, sino de sistemas reales funcionando un escalón por debajo de la capacidad y la eficiencia a la que ya se habían acostumbrado.

Readopción

A todo esto se añade que en caso de apagón las empresas no sólo tendrían que pensar en desadoptar temporalmente la IA, sino en readoptarla con otra lógica. Menos "poner IA en todas partes" y más "usar IA donde sobreviva a auditorías, apagones, cambios de proveedor y retorno temporal al trabajo manual".

Un informe de la OCDE permite sacar una conclusión acerca de la readopción: Si hubiera un apagón parcial de la IA, las empresas no podrían limitarse a esperar a que volviera. Tendrían que pasar de "adoptar IA" a garantizar que el negocio siga funcionando sin ella: reabrir procesos manuales, priorizar tareas y decidir qué usos recuperar primero. No todos los usos serían igual de urgentes. Algunos podrían esperar, otros requerirían sustitutos humanos y los más críticos sólo deberían volver cuando demostraran fiabilidad, control y supervisión. Usar la inteligencia artificial exige también prepararse para trabajar temporalmente sin ella.

En esa readopción no sólo quedaría en mal lugar el CEO de PwC en Estados Unidos, Paul Griggs, quien declaró esta semana que los socios que se resistan al avance de la IA no tendrán cabida en la firma... Los champions internos también pasarían una prueba dura. Perderían credibilidad quienes sólo impulsaran entusiasmo sin preparar planes alternativos, y ganarían peso quienes diseñaran controles y continuidad. Las primas por dominar la IA probablemente bajarían, sobre todo en perfiles muy dependientes de herramientas concretas. Seguirían valiendo más quienes, además de usar la inteligencia artificial sepan gestionar procesos, riesgos, datos y vuelta temporal al trabajo manual.

Una avería del sistema...

La hipótesis de un apagón de la IA suele imaginarse como un corte absoluto, con pantallas en negro, modelos fuera de servicio y una tecnología entera desapareciendo de golpe. Pero el escenario más verosímil se parece más a una avería progresiva: la IA se vuelve demasiado crítica para gobiernos, empresas y servicios antes de ser lo bastante robusta, útil y auditable, y entonces falla justo donde ya se la daba por garantizada. Mario Garcés, fundador de The Mind Kind, pone el ejemplo del choque entre Anthropic, la 'start up' fundada por Dario Amodei, y Donald Trump, y la fragilidad económica de la gigantesca infraestructura física que sostiene la nueva fiebre de la IA.

- Sobre el conflicto entre Trump y Anthropic, el Instituto de Estándares de Estados Unidos (NIST) define la IA 'confiable' como aquella que es válida además de transparente, responsable, segura y resiliente. En su perfil específico para IA generativa, NIST añade que las organizaciones deben preparar procesos alternativos, mecanismos de desconexión y planes de comunicación para la desactivación o retirada de estos sistemas. La IA puede degradarse, comportarse de forma inconsistente o simplemente no merecer confianza suficiente para usos críticos. Convertirla en infraestructura esencial antes de resolver eso no es una abstracción filosófica. Se trata de un riesgo operativo, y ahí es donde entra el conflicto entre Anthropic y el gobierno de Trump. El Pentágono defendió recientemente ante los tribunales la decisión de declarar a Anthropic un 'national security supply chain risk' después de que la empresa se negara a retirar restricciones que impedían usar su tecnología en armas autónomas y vigilancia doméstica. Anthropic llevó el caso a los tribunales y sostuvo que la medida era una represalia que podía costarle miles de millones de dólares. La empresa, sin embargo, no se opuso a colaborar con la defensa en general: en julio de 2025 anunció un acuerdo con el Departamento de Defensa por 200 millones de dólares para desarrollar capacidades de IA aplicadas a la seguridad nacional. El choque surgió por dos excepciones concretas: armas plenamente autónomas y vigilancia masiva interna.

- Eso convierte el caso en una lección sobre lo que sería un 'apagón funcional' de la IA. Trump y el Pentágono querían tratar esa tecnología como una capacidad crítica ya disponible para seguridad nacional. Anthropic respondió que los modelos de frontera actuales no son fiables para armas totalmente autónomas y que la vigilancia masiva de los estadounidenses vulnera derechos fundamentales. El apagón no consiste sólo en que un servidor caiga o en que una API deje de responder. También puede consistir en descubrir demasiado tarde que la tecnología no puede utilizarse donde el poder político ya la había presupuestado como madura.

- La otra cara del problema es que la IA no flota en el aire, sino que descansa sobre chips, centros de datos, redes y un flujo gigantesco de electricidad. La Agencia Internacional de la Energía recuerda que "no hay IA sin energía", en concreto sin electricidad para centros de datos. Y la OCDE describe la infraestructura de IA como "un ecosistema altamente complejo y a menudo altamente concentrado". Esta concentración no hace inevitable un colapso, pero sí que cualquier fallo financiero, técnico o regulatorio tenga un efecto multiplicado.

- Así, Mario Garcés habla de la "caducidad" de los centros de datos. No existe una regla fija y universal de cinco años para todo el hardware, pero sí una realidad industrial: estos activos se deprecian rápido y la aceleración tecnológica obliga a revisar su vida útil. Amazon informó en 2024 que reducía la vida útil de parte de sus servidores y equipos de red de seis a cinco años, y esa revisión recortaría su beneficio operativo de 2025 en 1.300 millones de dólares. La obsolescencia no es un miedo abstracto, y cabe preguntarse qué pasa si la infraestructura crece mucho más deprisa que el valor que realmente genera. Así, la discusión ya no gira sólo en torno a si la IA cambiará el mundo, sino a si las cifras cuadran.

- Nada de esto demuestra por sí mismo una burbuja condenada a estallar, pero dibuja una estructura muy sensible a retrasos, caídas de demanda o ingresos inferiores a los prometidos. Cuando Mario Garcés habla de un eventual 'apagón' ligado al fracaso de las empresas que hoy guían la IA, no describe la desaparición de la tecnología. Se refiere a menos capacidad disponible, a precios más altos, menos competencia, más dependencia de unos pocos proveedores y, en consecuencia, más vulnerabilidad para todos los que ya han hecho de la IA una pieza crítica. En ese escenario la IA seguiría existiendo, pero el servicio sería más caro, más escaso y más incierto.

- La IA puede volverse crítica antes de ser realmente fiable y auditable, como muestra el pulso entre Anthropic y Trump. Y también puede volverse estratégicamente imprescindible antes de demostrar que el modelo económico que la sostiene es estable a largo plazo. Si ambas cosas coinciden, el 'apagón' de la inteligencia artificial no vendrá como un evento apocalíptico. La gran pregunta ya no es si la IA puede fallar. La cuestión es si la estamos haciendo imprescindible demasiado pronto.

-

12:12

Lagarde vela sus armas ante la temida inflación

-

11:47

La factura global del conflicto se dispara

-

11:43

Por qué un exceso de IA puede aniquilar la gestión de personas

-

11:36

Indra ultima un acuerdo con la surcoreana Hanwha para un programa de artillería de 4.500 millones

-

11:36

BBVA confía en crecer y ganar rentabilidad apoyado en la diversificación y la IA pese al conflicto bélico