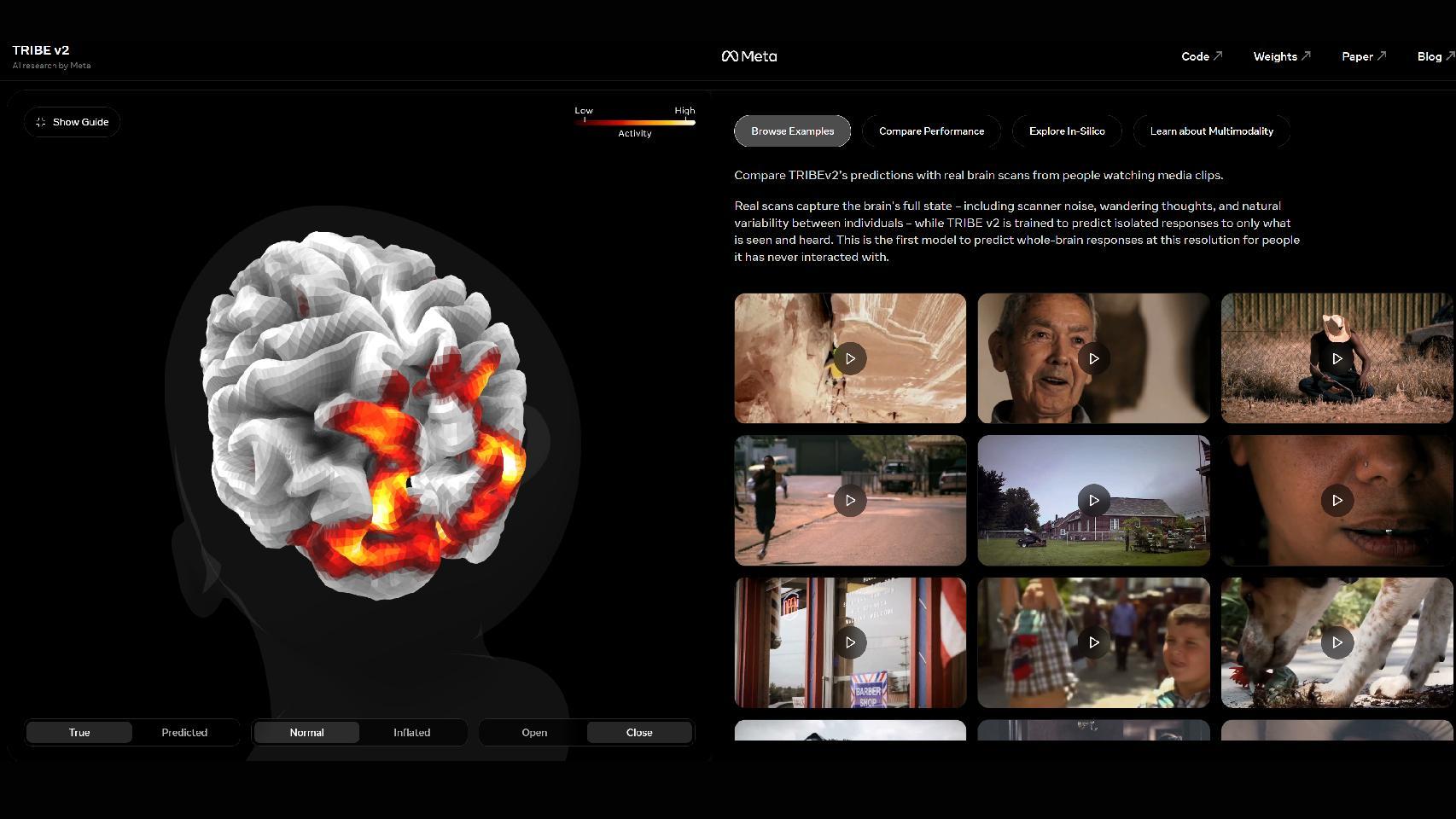

Demo del proyecto TRIBE v2. Meta Omicrono

Tecnología Zuckerberg sabe lo que piensas: la IA de Meta que predice cómo reaccionará tu cerebro ante vídeos, textos o sonidosLa compañía ha lanzado un modelo de IA que puede abrir una nueva era en neurociencia y enciende todas las alarmas sobre manipulación a gran escala.

Más información:Esta inteligencia artificial puede leer tu mente y descifrar tus sueños con una simple resonancia

Ismael Marinero Publicada 28 marzo 2026 02:44hCompañías como Meta tienen muchos defectos... y también algunas virtudes. La elección del timing más adecuado para anunciar algo no se cuenta entre estas últimas. La compañía que quiso adelantarse a todos con el metaverso y ha acabado enterrándolo tras dilapidar cerca de 80.000 millones de euros, acaba de sufrir una severa derrota judicial que ha vuelto a poner de manifiesto cómo las funciones de Instagram pueden enganchar "como tragaperras".

Y lo más sorprendente es cómo ha aprovechado justo este momento, un día después del 'momento tabaco' de las redes sociales, para hacer público un modelo de IA tan fascinante como terrorífico: "presentamos TRIBE v2 (Trimodal Brain Encoder), un modelo base entrenado para predecir cómo responde el cerebro humano a casi cualquier imagen o sonido", ha anunciado la compañía en su perfil de X.

Este nuevo algoritmo "se basa en más de 500 horas de grabaciones de resonancia magnética funcional (fMRI) de más de 700 personas para crear un gemelo digital de la actividad neuronal y permitir predicciones sin entrenamiento previo para nuevos sujetos, idiomas y tareas".

Meta lo sigue intentando con las gafas inteligentes pese a los escándalos y bloqueos de la UE, con nuevos modelosEn la práctica, TRIBE v2 es una plataforma de experimentación virtual, una especie de gemelo digital de la actividad neuronal sin necesidad de la participación de sujetos humanos para llevar a cabo estudios científicos, con un potencial enorme para la neurociencia. Además, Meta ha liberado el código y la demo para la comunidad científica, aunque conviene leer la letra pequeña.

Y es que, conociendo a Mark Zuckerberg y a su compañía, con noticias recientes que revelan cómo revisores humanos accedieron a vídeos íntimos de los usuarios de sus gafas con IA, este nuevo modelo de IA también puede ser el mayor peligro conocido hasta la fecha para la privacidad mental, la manipulación de las emociones y el abuso del poder corporativo.

Leer la mente

Desde la Antigüedad, el deseo de leer la mente ha servido para legitimar oráculos, chamanes y médiums de todo tipo, que mezclaban creencias ancestrales y ciertas dosis de espectáculo. Los mentalistas actuales como Anthony Blake son la versión contemporánea de ese impulso: utilizan técnicas psicológicas envueltas en misterio para, supuestamente, revelar detalles íntimos de cada persona leyéndoles la mente a distancia.

Más allá de tradiciones, supercherías y magos con ínfulas, la neurociencia lleva décadas intentando desentrañar las reacciones que se producen en el cerebro ante distintos estímulos. Y TRIBE v2, desarrollado por el equipo FAIR de Meta, con Stéphane d’Ascoli y Jean‑Rémi King como investigadores principales, se presenta como una de las soluciones más avanzadas para lograrlo.

Así funciona TRIBE v2, la IA de Meta para predecir la actividad cerebral

El modelo se ha entrenado con cerca de 1.000 horas de resonancias magnéticas funcionales de 720 voluntarios mientras veían películas, escuchaban podcasts y audiolibros o realizaban tareas de laboratorio. A partir de esos datos, los científicos detrás del estudio aseguran que la IA es capaz de predecir cómo se activan miles de puntos de la corteza y estructuras profundas del cerebro ante nuevos contenidos, sin necesidad de escanear a cada persona.

Para ello combina tres grandes modelos ya existentes: uno de lenguaje para texto, otro de audio para voz y sonido y otro de visión para vídeo, que convierten cada estímulo en una representación matemática. Esas representaciones se procesan con una red que integra la información a lo largo del tiempo y la traduce en mapas de actividad cerebral de alta resolución.

En el propio estudio, los autores destacan que su sistema “establece a la inteligencia artificial como un marco unificador para explorar la organización funcional del cerebro humano”. Y añaden que los resultados “refuerzan la posibilidad de un cambio de paradigma en neurociencia, pasando del mapa fragmentado de tareas aisladas al uso de modelos fundacionales predictivos de las funciones cerebrales y cognitivas”.

Beneficios para la neurociencia

El primer impacto es en los métodos usados por los neurocientíficos para llevar a cabo sus estudios. La neurociencia cognitiva se ha construido en base a experimentos muy acotados, difíciles de integrar entre sí, y este modelo busca juntar las distintas piezas del puzle para completar el mapa cerebral.

Según el artículo, TRIBE v2 cumple cuatro requisitos clave para aspirar a ese papel: integración (cubrir todo el cerebro y muchos tipos de tareas), rendimiento (igualar o superar métodos clásicos), generalización (funcionar en sujetos y protocolos nuevos) e interpretabilidad (permitir entender qué hace el cerebro y dónde).

En los experimentos, esta IA supera de forma sistemática a un modelo estadístico avanzado que se usa como referencia y que trabaja con exactamente los mismos datos. Lo más sorprendente es que, cuando se compara su salida con la 'foto promedio' de cómo responde el cerebro de un grupo de personas ante un mismo estímulo, la predicción del modelo encaja mejor con esa media que muchos de los escaneos individuales.

Diagrama del artículo sobre TRIBE v2 Meta Omicrono

Cuando se ajusta ligeramente el modelo con hasta una hora de datos de un nuevo sujeto, la precisión mejora entre dos y cuatro veces frente a un modelo de IA lineal entrenado desde cero para esa persona. Este esquema, el de un gran modelo base al que se suma un pequeño ajuste individual, es especialmente atractivo para aplicaciones clínicas, donde el tiempo para hacer este tipo de pruebas con escáner es limitado y supone un elevado coste económico.

El concepto central del trabajo es que permite la experimentación in silico, es decir, que puede llevar a cabo experimentos de neurociencia dentro del modelo antes de utilizar el escáner.

En la práctica, la IA de Meta reproduce de forma virtual localizadores clásicos de visión, recuperando áreas como las caras, los lugares, los cuerpos o las palabras, con mapas cerebrales muy similares a los obtenidos en humanos reales. También puede replicar contrastes de lenguaje, como frases frente a listas de palabras u oraciones complejas frente a frases simples, activando redes semánticas y sintácticas ya conocidas.

Esta capacidad abre varias posibilidades: permite probar los experimentos previamente para elegir de antemano los estímulos y duraciones que dan mejores resultados, ayuda a ver qué zonas del cerebro forman redes como la del lenguaje o el sistema visual y, además, posibilita estudiar cómo se mezclan texto, audio y vídeo en diferentes áreas.

Un paciente de ELA consigue controlar iPhone y iPads usando su mente: "puede manejar cualquier dispositivo"Los autores admiten, sin embargo, límites claros: la fMRI no capta la dinámica a milisegundos y, a día de hoy, esta IA "trata el cerebro como un observador pasivo de estímulos naturalistas; todavía no modela el cerebro como un agente activo que produce comportamiento".

El lector de mentes

Pese a sus bondades para la neurociencia, si se traslada esta tecnología al contexto de una gran tecnológica como Meta, la imagen cambia. Esta IA puede convertir casi cualquier vídeo, audio o texto en un mapa detallado de qué zonas del cerebro humano típico se activarían: regiones emocionales, redes asociadas al pensamiento espontáneo, áreas de lenguaje, sistemas de recompensa o zonas prefrontales implicadas en el control cognitivo.

Por eso conviene recordar que Meta lleva años optimizando el algoritmo de Instagram para maximizar el tiempo de visionado, las reacciones y los compartidos a partir de enormes volúmenes de datos de comportamiento.

De esta manera sabe, por simple correlación estadística, qué funciona mejor para captar la atención o provocar enfado, los dos principales estímulos presentes en las redes sociales actuales. Una tecnología como TRIBE v2 añade una capa nueva: ofrece un mecanismo para pasar de correlaciones a causalidad, explicando qué patrones de actividad cerebral están detrás del rendimiento de cada vídeo de gatitos o tuit incendiario de un político.

Captura de pantalla de la demo de TRIBE v2. Meta Omicrono

Si a eso se suman sistemas internos capaces de promocionar contenidos en el feed de rangos específicos de población muy concretos, Zuckerberg tendría un control con el que cualquier supervillano de cómic jamás habría podido soñar.

Según los resultados obtenidos por Stéphane d’Ascoli y Jean‑Rémi King, Meta tendría una infraestructura con capacidad, al menos en teoría, para diseñar y probar narrativas orientadas a provocar ciertos estados cerebrales (mayor activación emocional, reducción del control prefrontal, refuerzo de determinadas asociaciones) antes de exponer a cualquier usuario real a ese contenido.

Desde ese punto de vista, la línea entre tener enganchada a buena parte de la población mundial y poder influir de forma estratégica en sus opiniones, emociones o decisiones colectivas se vuelve muy fina.

El otro gran problema ético que plantea esta herramienta es que se presenta como investigación básica, pero la elección de licencia es reveladora: el modelo se publica bajo una CC BY‑NC, con lo que Meta se reserva los derechos comerciales.

Grok se va a la guerra: los peligros de que la IA tome el control de la estrategia militar y potencie las armas autónomasAsí, la comunidad científica puede experimentar en entornos no comerciales, pero cualquier explotación a gran escala, integrada en productos o servicios masivos, queda en manos de la compañía.

Privacidad cerebral

El modelo abre varios frentes incómodos. El primero tiene que ver con la privacidad mental. Aunque el sistema trabaja con promedios y no escanea a cada usuario en concreto, el simple hecho de cruzar hábitos digitales (qué vídeos ves, cuánto tiempo los miras, qué te hace reaccionar...) con predicciones de actividad cerebral ya permite inferir estados mentales sin que nadie te haya puesto un casco ni te haya hecho una resonancia.

El segundo aspecto es la manipulación. Un modelo que sabe de antemano qué contenido activa emociones fuertes, reduce el pensamiento crítico o refuerza ciertos sesgos se convierte en una herramienta de diseño de mensajes y de manipulación sin precedentes. No para que algo te guste más, sino para que te cueste más cuestionarlo o ponerlo en duda. En contextos electorales o momentos geopolíticos tan delicados como el actual, eso tiene implicaciones muy peligrosas.

La tercera cuestión es quién tiene este poder. Una infraestructura como la de Meta, capaz de distribuir contenido a escala global y, gracias a TRIBE v2, de predecir cómo responderá el cerebro ante ese contenido, no está al alcance de cualquiera. No hay que olvidar que en este mismo ecosistema también opera Palantir, la empresa detrás de controvertidas aplicaciones de vigilancia masiva de la población como las que usa ICE para localizar y deportar inmigrantes en EEUU.

Diagrama de la estimulación de las áreas del cerebro dependiendo del contenido. Meta Omicrono

Su fundador, Peter Thiel, fue uno de los primeros grandes inversores de Facebook y mantiene una relación cercana con el propio Zuckerberg, por lo que no es descartable una alianza o aprovechamiento de la herramienta (o de otra similar) para sus propios y siniestros fines, con el Pentágono y Donald Trump como garantes de su supuesta legalidad.

Por último, la regulación todavía no ha llegado... ni se la espera. Las leyes de protección de datos actuales están pensadas para proteger la navegación en Internet, nuestros correos electrónicos o ubicaciones, no para predicciones de activación de la corteza cerebral. Nadie ha definido todavía si deducir el estado mental de una persona a partir de lo que consume debe tratarse como un dato especialmente sensible, aunque evidentemente lo sea.

El propio estudio demuestra que, con apenas unos minutos de datos de una persona, el sistema ya se ajusta a ella con mucha precisión. A medida que los implantes cerebrales como los de Neuralink y los cascos de neuroestimulación se vuelvan parte de la vida cotidiana, la pregunta no es si esta tecnología puede predecir la respuesta de un cerebro individual en tiempo real, sino cuándo empezará a hacerlo.