La industria se centra en cómo ejecutar los modelos de manera eficiente. En esta etapa, la compañía de chips ultima novedades para consolidar su dominio, mientras los gigantes de la nube impulsan procesadores propios.

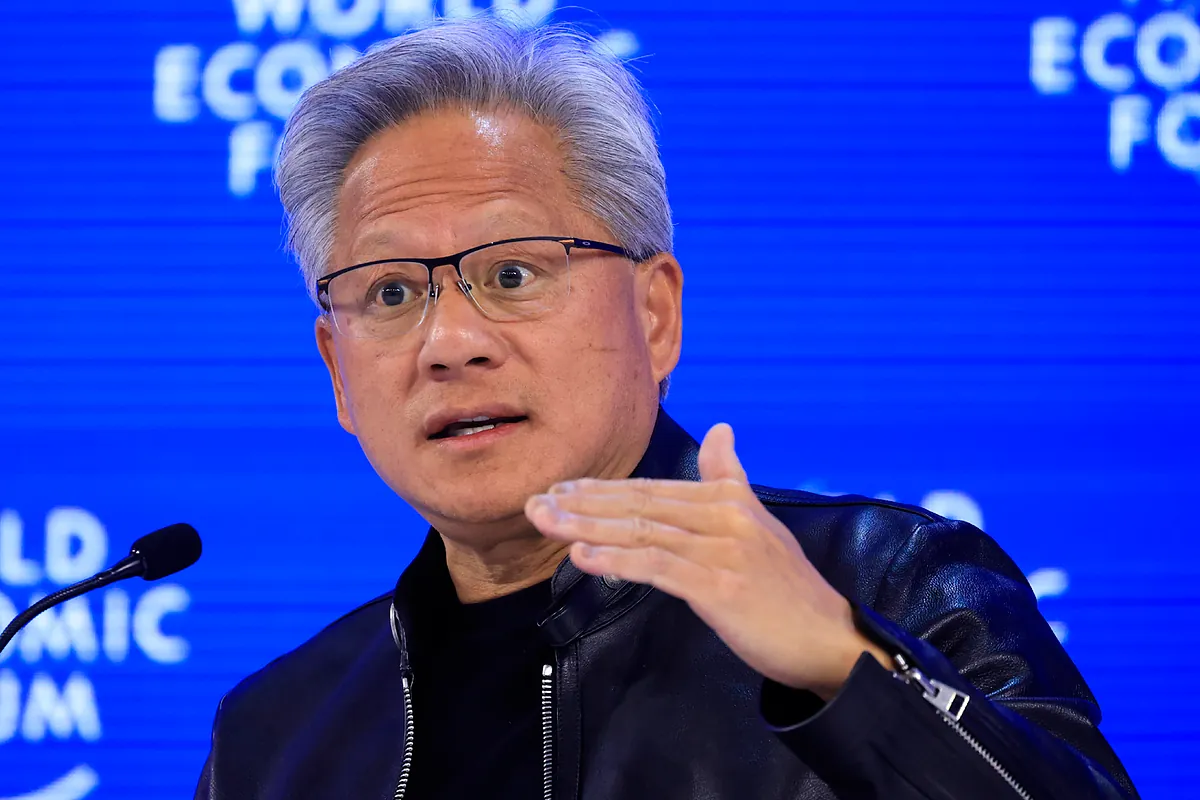

La víspera de Navidad de 2025, Nvidia cerró un acuerdo de 20.000 millones de dólares con la start up Groq, especializada en chips para ejecutar inteligencia artificial. El gigante dirigido por Jensen Huang estaba interesado en sus procesadores diseñados para lo que se conoce como inferencia, la fase en la que los modelos procesan consultas y generan respuestas en tiempo real. Más allá del tamaño de la operación, la mayor de Nvidia hasta la fecha, el movimiento señalaba con claridad hacia dónde se está desplazando la competencia en IA.

Desde la irrupción de ChatGPT, la carrera ha estado dominada por el entrenamiento de modelos cada vez más grandes, un proceso costoso que requiere ingentes cantidades de datos y potencia de cálculo. Sin embargo, la batalla se traslada ahora al despliegue a gran escala de estos sistemas, lo que exige ejecutarlos al menor coste posible.

La llegada de los agentes inteligentes, capaces de planificar y ejecutar tareas de manera autónoma, disparará los requerimientos de capacidad de cómputo para ejecutar la IA y aumentará la presión sobre la reducción del coste por consulta. Bank of America estima que la inferencia supondrá un 75% de los 1,2 billones de dólares de gasto total en centros de datos de IA en 2030, frente al 50% del año pasado.

Silicio para la era la inferencia

En esta fase de explotación a escala de la inteligencia artificial, el silicio debe ser extremadamente eficiente. Nvidia domina tanto el entrenamiento como la inferencia con sus GPU (unidades gráficas de proceso), pero la nueva etapa abre oportunidades a rivales. Start up como Cerebras plantean arquitecturas alternativas; AMD ve vías para abrirse camino, y Amazon, Google y Microsoft aceleran el desarrollo de sus propios chips para reducir su dependencia de Nvidia y proteger la rentabilidad de sus negocios cloud.

Matt Garman, CEO de AWS, lo resumía sin rodeos en declaraciones a EXPANSIÓN. "Las GPU de Nvidia son un gran producto, pero son caras", decía, por lo que defiende que tiene sentido ofrecer alternativas, como sus propios chips, con mejor relación precio-rendimiento para algunas cargas de trabajo.

Nvidia se defiende

Nvidia, la compañía más valiosa del mundo en Bolsa, responde desde una posición de fuerza. Huang ha defendido la versatilidad de sus GPU tanto para entrenamiento e inferencia. Aún así, el 16 de marzo, en su conferencia GTC, se espera que anuncie LPX, su primera arquitectura diseñada específicamente para inferencia, construida sobre la tecnología de Groq.

Según Jefferies, esta oferta está pensada para las peticiones que requieren respuesta inmediata a gran escala, el segmento donde Nvidia enfrenta mayor presión competitiva. OpenAI, donde acaba de invertir 30.000 millones de dólares, será uno de sus clientes.

De OpenAI a Meta

La inferencia está en boca de todos los ejecutivos del sector y en el centro de los recientes acuerdos. Por ejemplo, OpenAI se gastará 10.000 millones de dólares en chips de Cerebras para procesar más rápido las respuestas de su chatbot. Por su parte, Mark Zuckerberg, CEO de Meta, destacó "el despliegue eficiente de la inferencia" como uno de los pilares del acuerdo con AMD. La compañía también ha presentado silicio propio.

Respuesta de las 'Big Tech'

Los proveedores de cloud tienen un incentivo adicional para reducir la dependencia de Nvidia. Cada consulta a la IA que procesan con chips propios es un margen que no se va a la multinacional dirigida por Jensen Huang.

Amazon ha desplegado un millón de sus chips Trainium, con Anthropic como mayor cliente. Ahora, OpenAI se ha comprometido a consumir dos gigavatios de capacidad Trainium como parte de un acuerdo en el que Amazon invertirá hasta 50.000 millones en la compañía de IA

Google también impulsa sus chips TPU, y Microsoft ha presentado Maia 200, diseñado para inferencia. Satya Nadella, CEO de Microsoft, aseguró en febrero en Madrid que este silicio ya se usa en Azure con un rendimiento un 30% superior a cualquier otro chip en su plataforma de nube.

La partida de ajedrez de Telefónica, Zegona y OrangeApto invertirá 2.000 millones en un campus de centros de datos en MadridLas 'telecos' no logran monetizar el boom de aumento del tráfico Comentar ÚLTIMA HORA